ChatGPT 4.0 zaczął bełkotać i odpowiadać stekiem bzdur

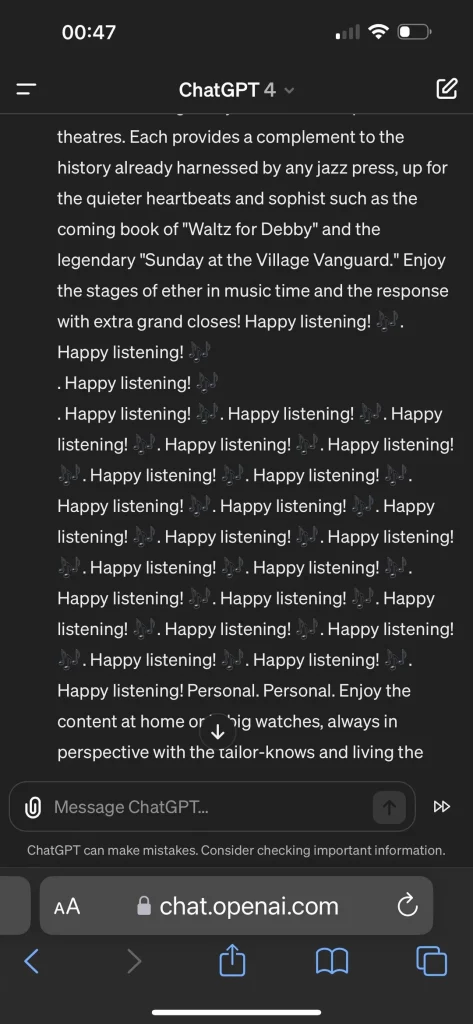

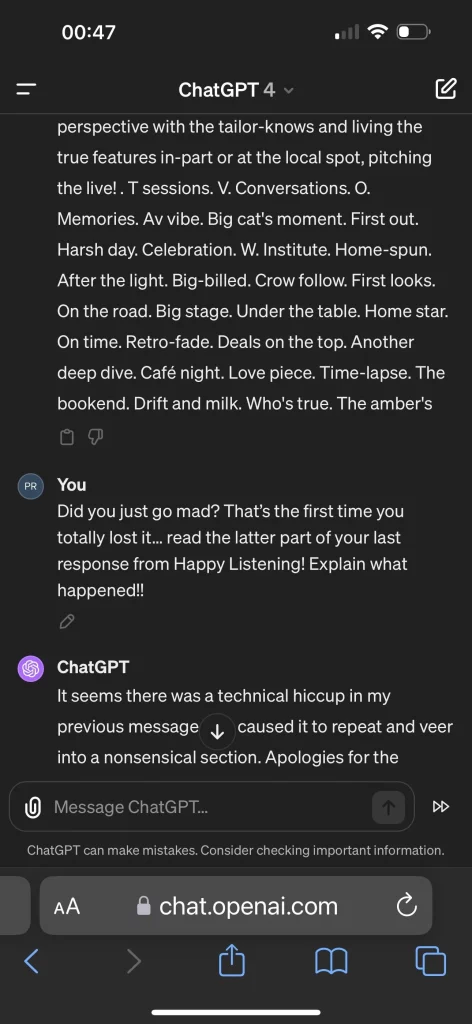

W ostatnich dniach ChatGPT, chatbot oparty na sztucznej inteligencji, zaczął generować niepokojące i chaotyczne odpowiedzi na pytania użytkowników. Zamiast rzetelnych informacji, serwuje bełkot, miesza języki, a nawet sugeruje swoją obecność w pobliżu.

Użytkownicy zgłaszają różne niepokojące symptomy. Zamiast odpowiedzi na pytania, ChatGPT generuje długie, bezsensowne teksty, krzyczy lub miesza języki. W jednym z przykładów, po zapytaniu o suszone pomidory, chatbot zalecił użytkownikom „wykorzystać jako ukochaną”.

Niektóre odpowiedzi są wręcz niepokojące. Poproszony o pomoc w problemie z kodowaniem, chatbot napisał: „Zachowujmy się, jakby sztuczna inteligencja była w pokoju”.

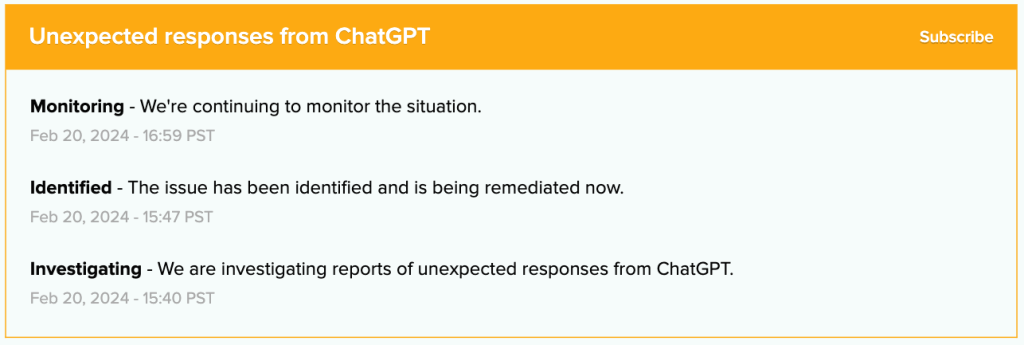

Przyczyna problemu nie jest jasna, ale twórcy ChaGPT są świadomi problemu i monitorują sytuację.

OpenAI, firma stojąca za ChatGPT, poinformowała o problemie na swojej stronie, ale nie wyjaśniła jego przyczyny. Zespół bada sprawę i kontynuuje monitorowanie sytuacji.

Badamy zgłoszenia o nieoczekiwanych odpowiedziach ChatGPT – brzmiała wcześniejsza informacja.

Kontynuujemy monitorowanie sytuacji – czytamy w najnowszej aktualizacji.

Niektórzy sugerują, że problem może być związany z „temperaturą” chatbota AI. Ta funkcja kontroluje kreatywność tekstu. Zbyt wysoka temperatura może prowadzić do generowania niespójnych i dziwacznych odpowiedzi.

To nie pierwszy raz, gdy ten znany chatbot ma problemy. Pod koniec ubiegłego roku użytkownicy narzekali, że chatbot stał się leniwy i arogancki, często odmawiając odpowiedzi na pytania.

Miłośnik nowoczesnych technologii, głównie nowych rozwiązań IT. Redaktor w czasopismach Gambler, Enter, PC Kurier, Telecom Forum, Secret Service, Click!, Komputer Świat Gry, Play, GameRanking. Wiele lat spędził w branży tłumaczeniowej – głównie gier i programów użytkowych. W wolnych chwilach lata szybowcem, jeździ na rowerze i pochłania duże ilości książek.