Sztuczna inteligencja demaskuje funkcjonariuszy OMON na Białorusi

Sztuczna inteligencja została zaprzęgnięta do odkrywania tożsamości zamaskowanych funkcjonariuszy OMON na Białorusi.

AI rozpoznaje funkcjonariuszy OMON po oczach

Na filmie widać dwóch funkcjonariuszy OMON z pałkami i protestującego kulącego się na ziemi. Są tam także przechodnie głośno domagający się jego uwolnienia.

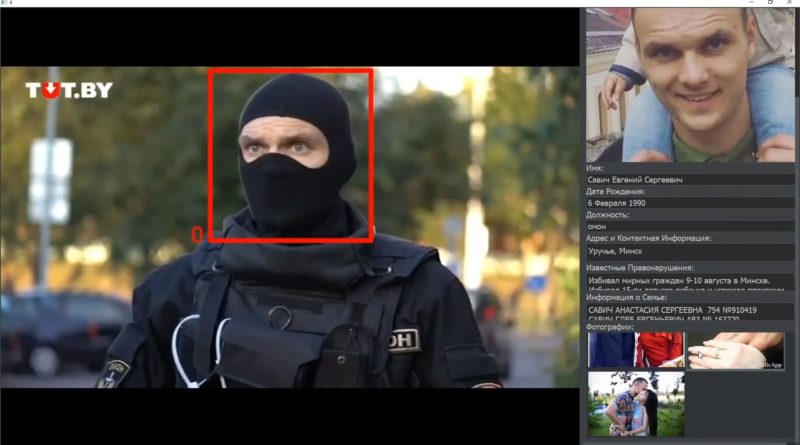

Gdy jeden z funkcjonariuszy odwraca się do kamery, zza kominiarki widać tylko jego oczy. Film zostaje zatrzymany, pojawia się okno aplikacji i po chwili widać komunikat: „Wykonuję segmentację twarzy…”.

W ciągu kilku sekund komputer analizuje szereg zdjęć, porównując oczy z filmu z tymi z fotografii. Mężczyzna zostaje zidentyfikowany jako 29-latek z Mińska. Kliknięcie pola z napisem „Rekonstrukcja” sprawia, że twarz mężczyzny zostaje nałożona na zamaskowanego funkcjonariusza OMON na filmie.

Programiści wspomagają swoją ojczyznę

Film, który przedstawia sytuację, aplikację i przesłanie został opublikowany na YouTube przez Andrew Maximova, urodzonego w Mińsku amerykańskiego programisty.

Prezentuje sposób, w jaki sztuczna inteligencja może zostać wykorzystana do zdemaskowania funkcjonariuszy organów ścigania zaangażowanych w brutalne rozpędzanie demonstracji. Te odbywają się każdego dnia po dyskusyjnej reelekcji Aleksandra Łukaszenki, który piastuje urząd prezydenta Białorusi od 1994 roku.

Maximov wyemigrował do USA w wieku 20 lat i obecnie mieszka w Los Angeles w Kalifornii. W filmie mówi, że funkcjonariusze OMON nie powinni działać bezkarnie i czuć się bezpiecznie za maskami.

„Celem było zademonstrowanie ludziom, że zamiast przestrzegać prawa na Białorusi, codziennie je łamią, że istnieją możliwości technologiczne, które pozwalają na umieszczenie ich twarzy na zdjęciach i filmach będących dowodami ich przestępstw” – powiedział w wywiadzie dla RadioFreeEurope / RadioLiberty.

„Chociaż w całym białoruskim społeczeństwie istnieją bardzo aktywne inicjatywy deanonimizacji, uważamy, że można uczynić je o wiele bardziej widocznymi, poprzez nałożenie ich twarzy na materiały wideo z miejsca zbrodni.”

Maximov powiedział, że był w pierwszej linii protestów przeciwko reelekcji Łukaszenki w 2010 roku. W tym roku powiedział: „Czułem, że nie mam moralnego prawa do milczenia.”

Protesty i ich poparcie

Protesty trwają od ogłoszenia wyników wyborów na urząd Prezydenta Białorusi. Protestujący są jednak brutalnie rozpędzani przez zamaskowanych funkcjonariuszy OMON, którzy na swoich mundurach nie mają żadnych oznaczeń, insygniów i nazwisk. Na twarzach noszą kominiarki, które mają sprawić, że będą anonimowi. Prześladowanym udało się zdjąć je kilku funkcjonariuszom, dzięki czemu ich tożsamość została odkryta.

Protesty są popierane przez rzesze obywateli innych państw, a wynik wyborów nie został uznany przez rządy wielu krajów.

Aplikacja Maximova pozwoli na odkrycie tożsamości innych nagranych i sfotografowanych funkcjonariuszy.

Kontrowersje wokół aplikacji

Aplikacja Maximova bazuje na porównywaniu wyglądu oczu i ich oprawy z fotografiami dostępnymi w bazach danych. To od ich jakości zależy dokładność porównań.

Łatwo można wyobrazić sobie scenariusz, w którym kilka osób ma podobny układ oczu, brwi, nosa. Tylko tyle widać w „okienku” kominiarki. Co w przypadku, gdy aplikacja się pomyli i sparuje obraz z niewinnym obywatelem, czy funkcjonariuszem, którego w danym miejscu nie było?

Czy aplikacja może pomóc także drugiej stronie, choćby w przypadku protestów ludności w Hongkongu? Tam protestujący kryli swoją tożsamość za kominiarkami i chustami. Mając dużą bazę obywateli, władza może wykorzystać podobne algorytmy do odkrycia, kto stoi za protestami.

Pełne zaufanie tego typu algorytmom też może przynieść sporo problemów niewinnym osobom. Mogły one czymś mogły narazić się komuś, kto manipulując wizerunkami, może nanieść twarz takiej osoby na film i sprawić, że zostanie ona nieprawnie oskarżona.

Ważne jest także to, że w komentarzach dla RFE / RL Maximov przyznał, że jego „Technologia nie jest doskonała i może popełniać błędy. Jednakże obawy związane z prywatnością dotyczące każdego tego rodzaju systemów jest to dla nas ważna sprawa i wolelibyśmy, aby w ogóle nie musiały one istnieć, ale na nierównym polu gry, gdzie codziennie setki ludzi są bezprawnie krzywdzone, jeśli ma to szansę złagodzić przemoc, musimy spróbować.”

Clearview

Kontrowersje wzbudza także aplikacja Clearview, o której pisaliśmy w styczniu. Pozwala ona identyfikować osoby ze zdjęć. Aplikacja korzysta z ogromnej bazy danych gromadzonych z portali społecznościowych i innych źródeł.

Potrafi zidentyfikować osobę, podać jej nazwisko, adres, czy miejsce pracy. Mówi się, że korzystają z niej służby w USA, w tym FBI. Służby nie potwierdzają i nie zaprzeczają.

Źródło: Andrew Maximov / YouTube, RFE / RL

Entuzjasta technologii IT, mobile, wearables. Freelancer, od lat w branży mediów IT/Mobile (CD-Action, NeXT, PC Format, CafePC.pl, Benchmark.pl, Mobility, Komputer Świat, Bezprawnik, Startupmag, IoTLab.pl) , były PRowiec (Sweex i Hannspree) i logistyk. Pasjonat jedzenia, gotowania, zdrowego odżywiania, wędrówek, jazdy na rowerze, książek, kina, opery, teatru i wielu innych.